LTX-2の記事はこちらで書いています。

今回はLTX-2.3になります。

自分はクリエイターには程遠い人なので、この2つの違いがよくわかりません。

「とりあえず、Intel Arcでも動いたよ」

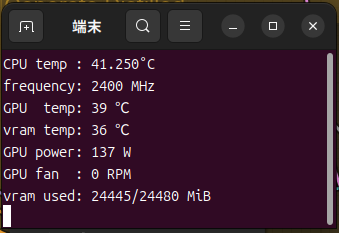

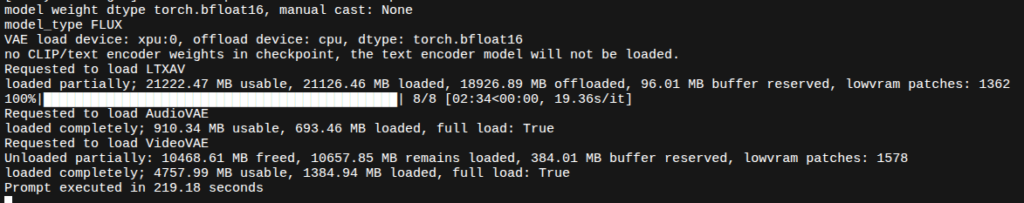

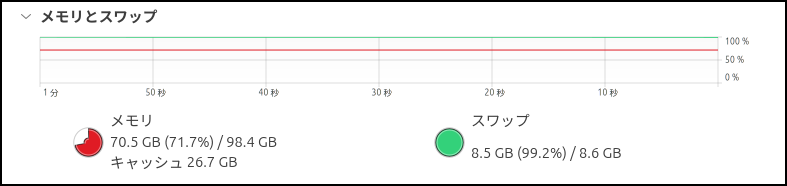

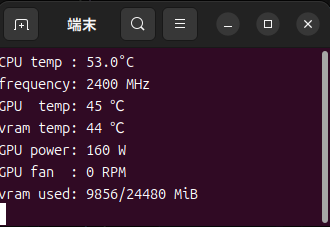

「メインメモリとVRAMはこれくらい使うよ」

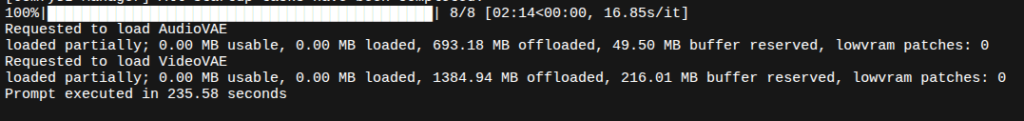

「時間はこれくらいかかったよ」

といった動作報告です。

自分の環境は「Arc Pro B60」なので「Arc B580」とかでも動いたよって方がおられたら教えてくださいね。

それでは、やっていきましょう。

とりあえずComfyUIのインストール

これらをインストールしておいてください。

特に「ComfyUI-managerのインストール」をやっておくと、モデルファイルのダウンロードが楽になります。

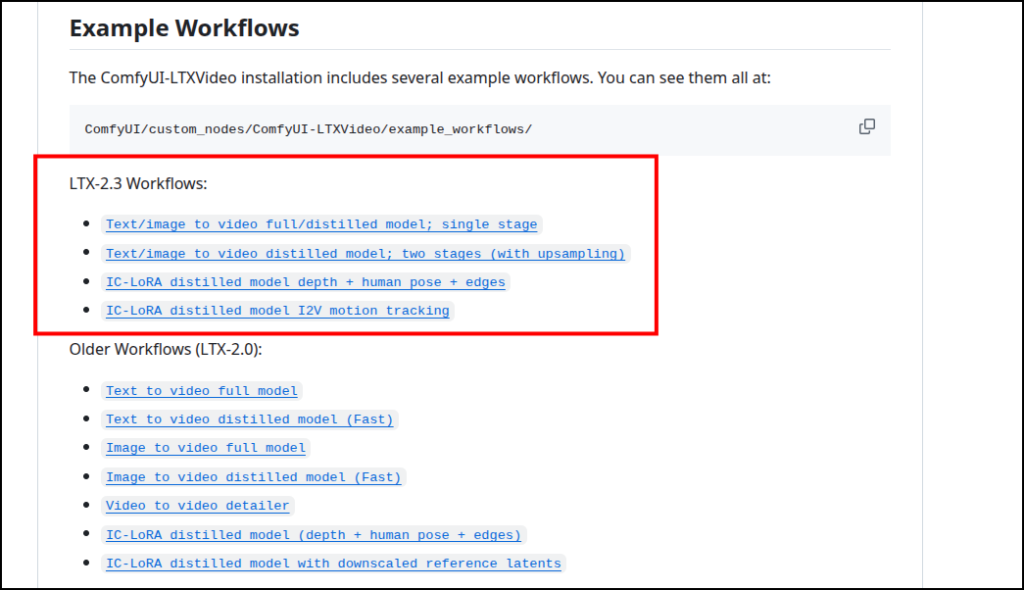

ワークフローはどこに?

LTX-2.3のワークフローは以下のリンク先にありました。

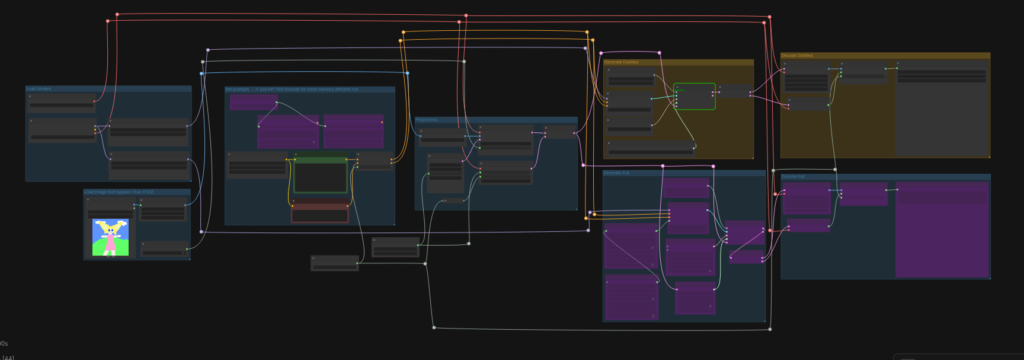

Text/image to video full/distilled model; single stage」を使います。「LTX-2.3_T2V_I2V_Single_Stage_Distilled_Full.json」がダウンロードできると思います。足りないモデルを追加でダウンロード

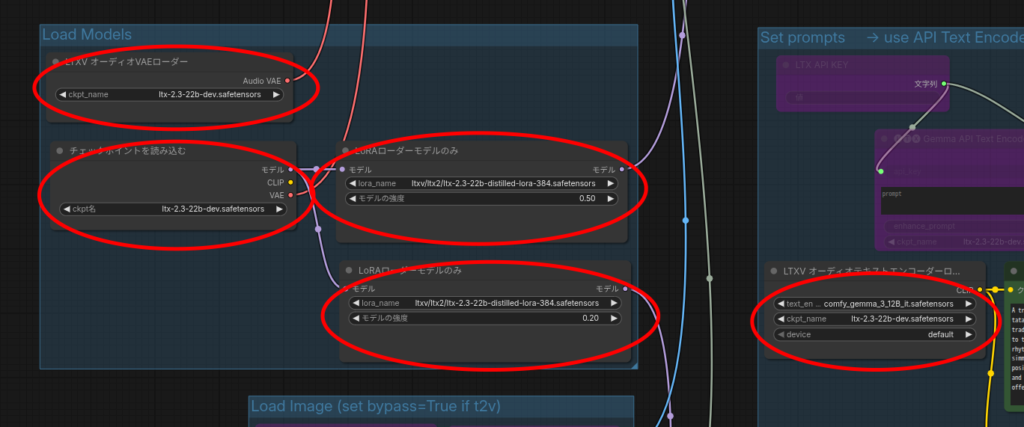

上のワークフローとComfyUI-managerでもダウンロードできないモデルファイルがありました。

このテキストエンコーダですね。

LTX-2と共用のようです。

もし、まだダウンロードしていない方はこちらからどうぞ。

T2I(text-to-image)で生成

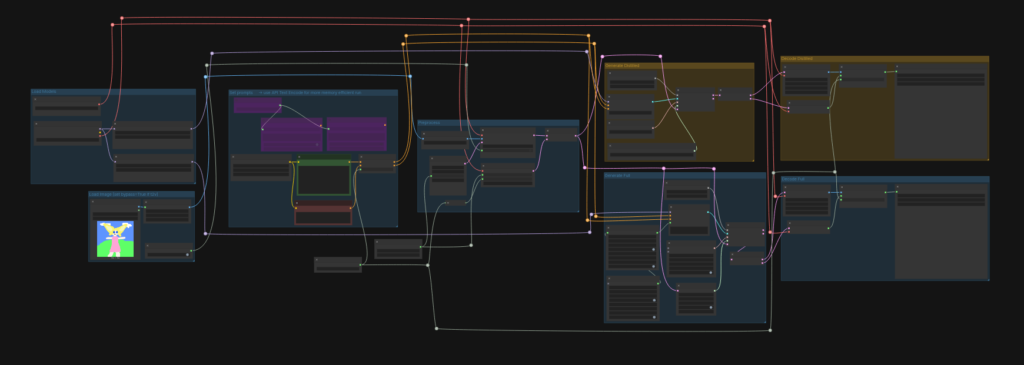

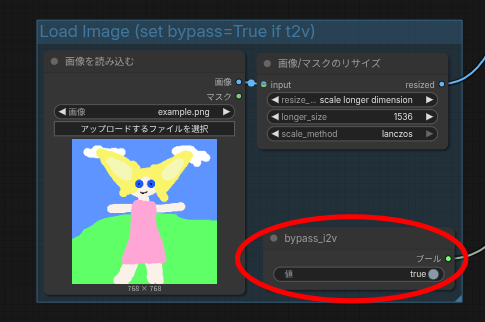

どうもこのワークフローで「T2I(text-to-image)」と「I2I(image-to-image)」両方をまかなえるようです。

あとは「通常版のモデル」と「蒸留版(distilled)のモデル」も使い分けられるみたいですね。

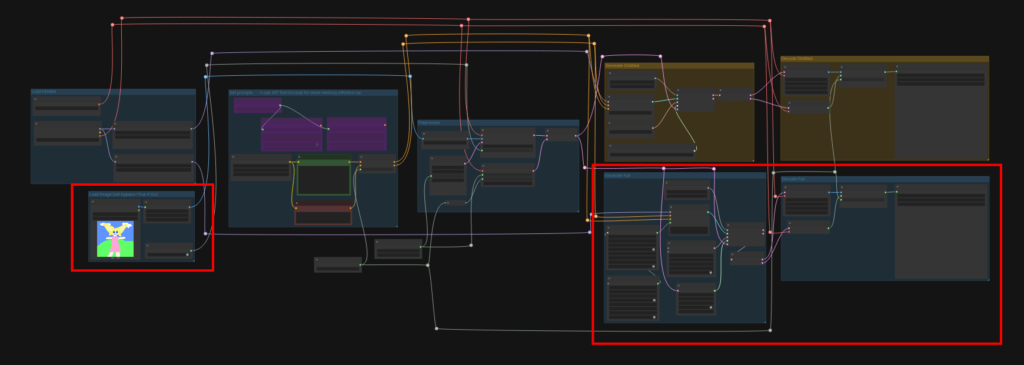

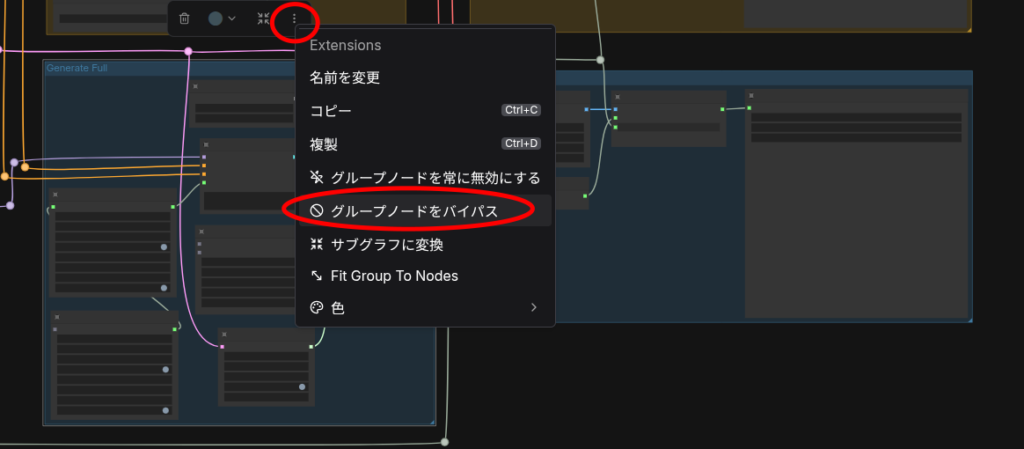

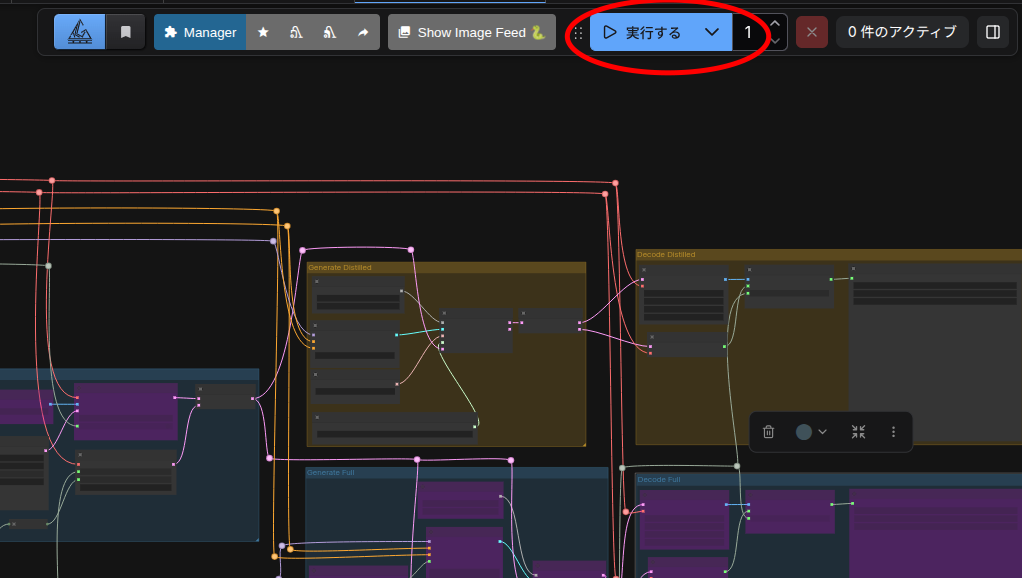

今回は「T2I」+「蒸留版」なので、使わないノードグループをバイパスに設定します。

今回のComfyUIの起動オプションは「python main.py –auto-launch」です。

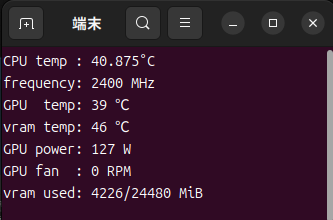

「–novram」を付けるとどうなるか

ComfyUIの起動オプションを「python ./main.py –auto-launch –novram」に変更してみます。

最後に

自分もいろいろワークフローをいじって自分の動画を作ってみよう!なんて思っていたんですが、やっぱり自分はクリエイターには向きませんね・・・。

酷い動画ばかり量産されてしまって、断念しています。

今回は、とりあえず動作確認だけしてみました。

Arc持っていて、LTX-2.3に興味がある方は試してみてはどうでしょう?

以上です。

コメント