Amazonのアソシエイトとして、当ブログは適格販売により収入を得ています。

前回の記事「話題のgemma-4を試してみた」で、llama.cppをvulkanで動かしたら「Radeon RX 470」に「Intel Arc A750」が負けたという内容を書きました(主旨は違いますが)。

今回はOpenVINO GenAIでリベンジしたいと思います。

「Arc A750」でも十分動作しましたので、大抵のArcなら大丈夫でしょう。

ちなみに今回の記事内容はIntel Arcでしか動かないと思います。

それでは、やっていきます。

モデルファイル

OpenVINO GenAIはsafetensorsやggufは使えません。

独自の形式に変換する必要があります。

上のリンクからダウンロードできるようです。

safetensorsを変換する場合は以下のリンクが使えるらしいです(自分は使ってません)。

自力で変換する場合は、

#!/bin/bash

uv venv .venv_trans --python /usr/bin/python3

source .venv_trans/bin/activate

uv pip install openvino-genai optimum[openvino] datasets

MODEL="Qwen/Qwen3-8B"

QUANTUM="int4"

DIR_NAME=$(basename "$MODEL")

optimum-cli export openvino --model "$MODEL" --weight-format "$QUANTUM" ./models/"$DIR_NAME"-"$QUANTUM"こんな感じで変換できます(結構時間がかかる)。

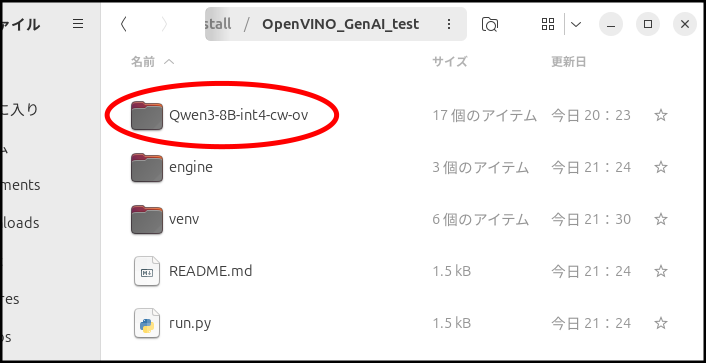

今回は、以下のモデルを使います。

ダウンロード方法は前回の記事を参考にしてください。

OpenVINO GenAI導入

環境構築に興味があったので、導入は自力でやりました(まぁほとんどGeminiがやってくれましたが)。

githubに上げてます。

テストするためだけのものなので、非常に簡易的です。

#!/bin/bash

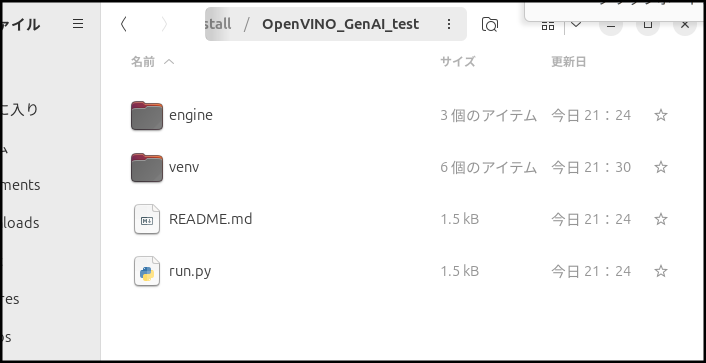

mkdir -p ~/install

cd ~/install

git clone https://github.com/toaru-ubuntu/OpenVINO_GenAI_test.git

cd OpenVINO_GenAI_test

python3 -m venv venv

source ./venv/bin/activate

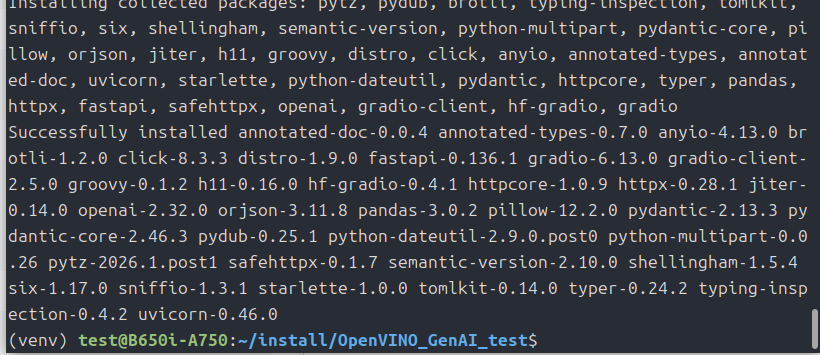

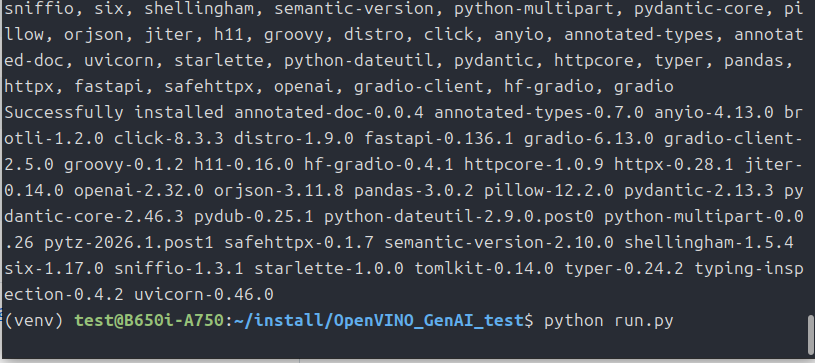

pip install openvino-genai optimum[openvino]

#OpenVINO_GenAIをサーバーとして起動するのに必要なライブラリ等

pip install fastapi uvicorn pydantic openai gradio

これで準備は完了です。

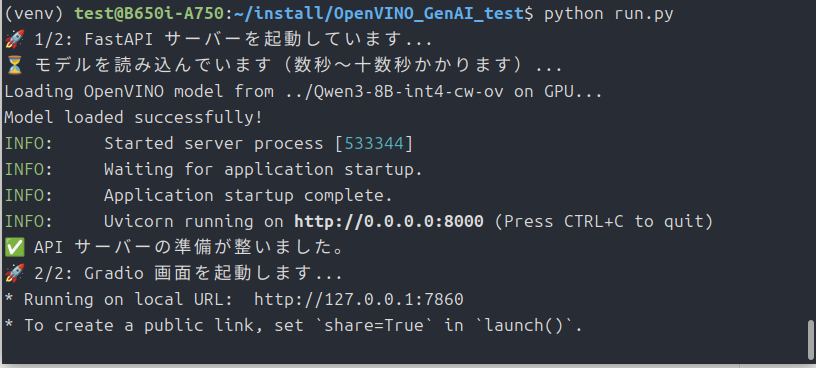

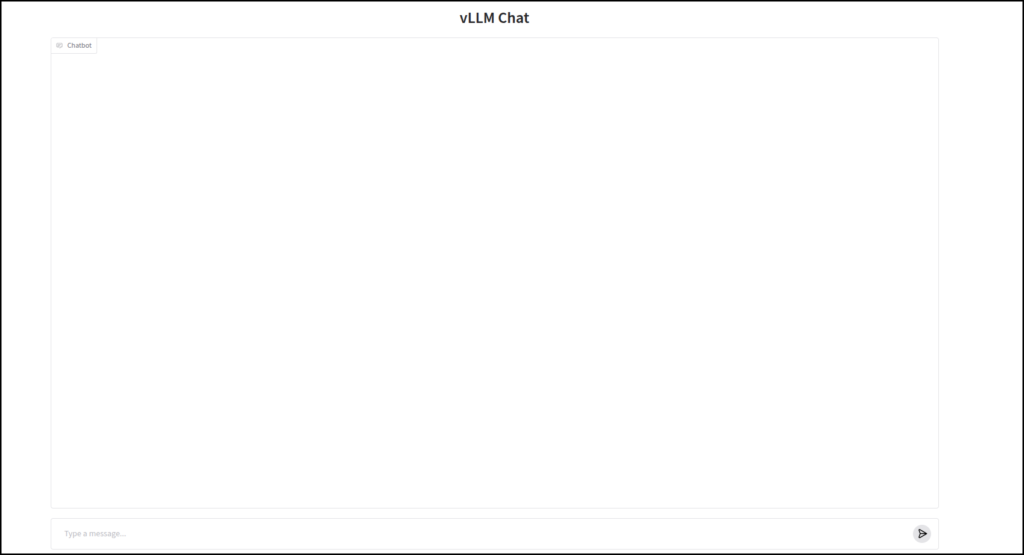

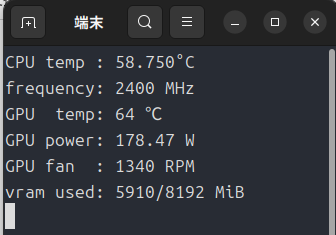

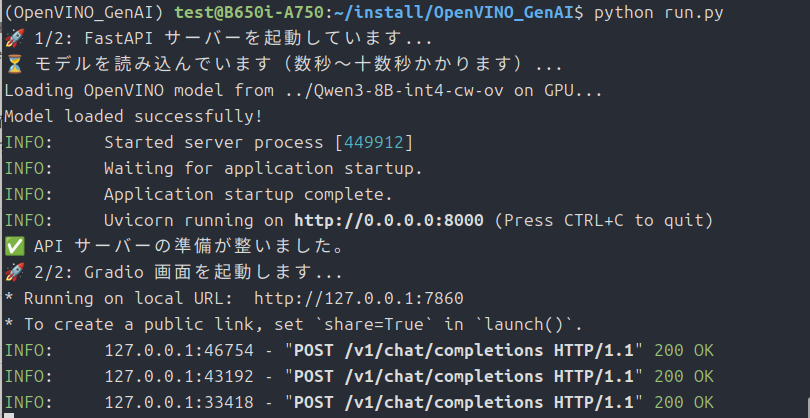

いざ、実行

A380でもギリ動くかもしれませんが、コンテキスト長を増やすとエラーになるかもしれません。

最後に

よく見たらモデルファイルが「gemma-4」じゃないじゃん!と思ったそこのあなた。

そのとおりです、ごめんなさい。

gemma-4はまだOpenVINO GenAIには対応しておりません。

変換されたモデルもあるし、強引に動かすこともできるのですが全然パフォーマンス出ません。

対応しているなるべく新しいモデルないかなぁって探したのが今回のQwen3-8B-int4-cw-ovです。

OpenVINOに対応するにはもう少し時間がかかるみたいで。

このへんllama.cppは有利です。

Radeonを使っている方、素直にllama.cpp + vulkan で動かしましょう。

まぁ普通はollamaかLMStudioだと思いますけど。

今回は以上です。

追記

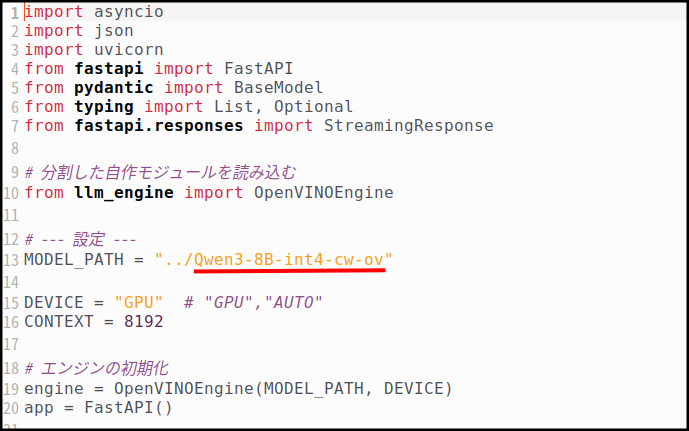

モデルファイルを変更したい場合、「engine/main.py」の

コメント