Amazonのアソシエイトとして、当ブログは適格販売により収入を得ています。

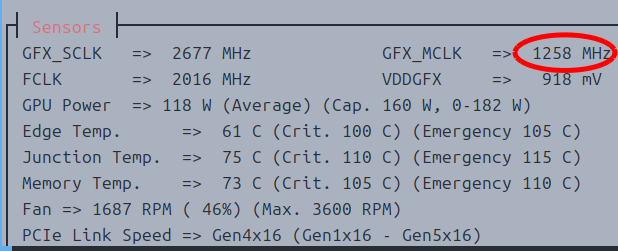

以前の記事で、Radeonで動画生成AIを実行する時、VAEがとても遅いという内容のものがありました。あれから、まだあまり日が経っていませんが、VAEの速度に変化があったので、今回記事にしました。

理由はわかりませんが、pytorchかComfyUIのバージョンアップ?

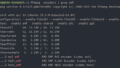

ちなみに試したtorchのバージョンは「2.10.0.dev20251012+rocm7.0」。

torchvisionのバージョンは「0.25.0.dev20251013+rocm7.0」

起動オプションは「python ./main.py --auto-launch --disable-xformers --use-pytorch-cross-attention」です。

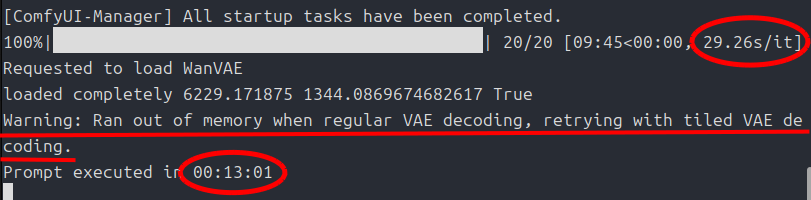

更に、「Warning: Ran out of memory when regular VAE decoding, retrying with tiled VAE decoding.」と表示されていますが、

以前から存在した機能のようですが、VRAMが足りなかった場合ちゃんと自動的にTiled処理に以降するようになったようです。

以前は処理が極端に遅くなったり、止まったりしていました。

日々進化しているということでしょうか?

見守っていきたいと思います。

pytorchのバージョンアップしたい方は、仮想環境(自分はvenv)をactivateしてから下のコマンドを実行してください。

pip install --upgrade --pre torch torchvision --index-url https://download.pytorch.org/whl/nightly/rocm7.0今回は以上です。

追記

ひょっとしたらVAEエンコードの方も使いやすくなっている可能性があります。

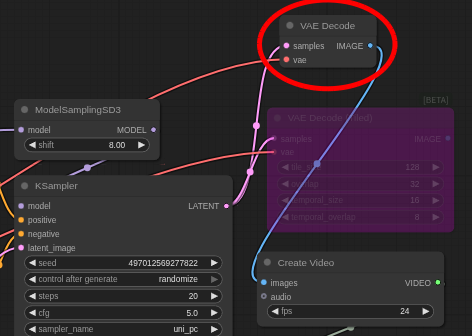

標準のノードでVAEエンコードできるということは、WanVideoWrapperのようなカスタムノードのVAEエンコードタイル処理を使わなくてもよいかもしれません。

image2video等使っている人には朗報かも。

コメント